大数据概率理论基础 构建海量数据处理的数学核心

在当今的信息化时代,大数据已成为驱动社会进步和技术创新的关键要素。处理海量、高速、多样、价值密度低的大数据,并非仅靠强大的计算能力就能解决。其背后,坚实的概率理论基础构成了理解、分析和挖掘数据价值的数学核心。本文将探讨大数据处理中几个关键的概率理论基础及其在计算机数据处理中的应用。

一、概率论:从不确定性到可预测性的桥梁

大数据往往伴随着显著的不确定性和噪声。概率论提供了描述和分析这种不确定性的数学语言。在处理非结构化或半结构化数据(如社交媒体文本、传感器日志)时,事件的随机性、数据缺失或错误是常态。概率模型,例如贝叶斯定理,允许我们利用先验知识和观测到的数据来更新对事件发生可能性的信念。这在垃圾邮件过滤、推荐系统和风险评估等场景中至关重要。通过将数据点视为来自某个概率分布的样本,我们可以对整体数据特征进行推断,即使无法处理每一个数据单元。

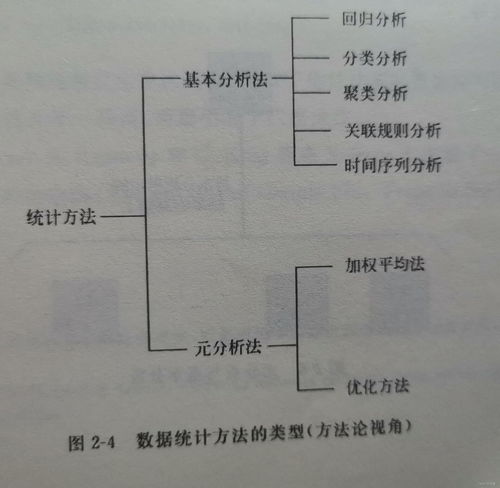

二、数理统计:从样本到总体的推断艺术

大数据通常可以被视为一个超大规模的总体。直接对全体数据进行计算(即“普查”)在计算资源和时间上可能代价极高,甚至不可行。数理统计中的抽样理论在此发挥了关键作用。通过合理的随机抽样方法(如简单随机抽样、分层抽样),我们可以从海量数据中提取一个具有代表性的子集(样本),并基于此样本对总体参数(如均值、方差、比例)进行估计,同时量化估计的不确定性(如置信区间)。这不仅大幅降低了计算复杂度,而且为分布式计算框架(如MapReduce)中的“分而治之”策略提供了理论依据——将大数据集分割成多个小数据块(可视为样本)并行处理,再汇果。

三、随机过程与时间序列分析:理解动态数据流

大数据常常以高速流的形式持续产生,例如网络点击流、金融交易记录、物联网传感器数据。这些数据具有时间依赖性。随机过程理论,特别是时间序列分析(如自回归模型、移动平均模型),为建模和预测这类动态数据提供了工具。通过分析数据在时间维度上的自相关性和趋势,我们可以进行短期预测、异常检测(如突然的流量峰值可能表示网络攻击)和模式识别。这对于实时数据处理系统至关重要。

四、大数定律与中心极限定理:稳定性的保证

这两个概率论中的基石定理,是大数据处理能够行之有效的根本保证。大数定律表明,当从总体中抽取的独立同分布样本量非常大时,样本均值会以极高的概率接近总体均值。这保证了基于大规模数据计算出的统计量(如平均值、点击率)是稳定可靠的。中心极限定理则指出,无论原始总体分布如何,大量独立随机变量之和的标准化形式近似服从正态分布。这为许多统计推断方法(如假设检验)在复杂大数据场景下的应用提供了理论支持,即使我们不清楚数据的具体分布。

五、概率图模型与机器学习:复杂关系的建模

面对高维度、结构复杂的大数据,概率图模型(如贝叶斯网络、马尔可夫随机场)提供了一种优雅的方式来可视化并编码随机变量之间的复杂依赖关系。它将图论与概率论结合,使得高维联合概率分布的表示、学习和推断变得可行。这直接支撑了许多机器学习算法,特别是在自然语言处理(如主题模型)、计算机视觉和知识发现等领域。深度学习中的许多结构也可以从概率建模的角度进行理解。

六、在计算机数据处理中的具体应用

在实际的计算机数据处理管道中,这些概率理论无处不在:

- 数据清洗与质量评估:使用概率模型识别并处理异常值和缺失值。

- 近似查询处理:在交互式数据分析中,对聚合查询使用随机抽样返回快速、带有误差边界的近似结果。

- A/B测试与实验设计:基于统计假设检验来科学评估算法或产品的变更效果。

- 推荐系统:利用协同过滤(本质上是概率模型)预测用户偏好。

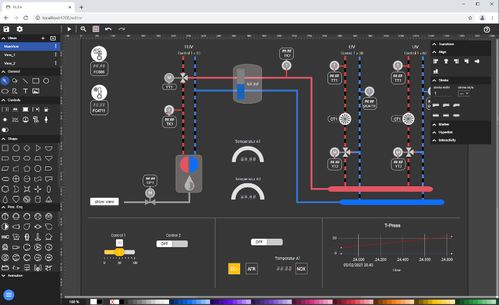

- 流数据处理:使用滑动窗口模型和概率算法(如Bloom Filter进行成员查询、Count-Min Sketch进行频率估计)在有限内存下实时处理数据流。

结论

大数据的技术实践离不开其概率理论的根基。从基本的统计描述到复杂的机器学习模型,概率理论为从海量、嘈杂的数据中提取可靠信息、做出稳健预测提供了必不可少的数学框架和原则。它帮助我们将数据的不确定性转化为可量化的风险与机会。因此,深入理解大数据背后的概率理论基础,对于设计高效、可靠的计算机数据处理系统,以及进行有深度的数据洞察,具有不可替代的价值。随着数据复杂度的进一步提升,概率理论将继续演化,并与计算科学更紧密地结合,以应对新的挑战。

最新产品